Yapay zeka uygulamasi

Yapay zeka uygulamasi: 2026'da urun yapisi degisti

Yapay zeka uygulamasi gelistirme — Claude, GPT, Gemini gibi LLM'ler urunlerin temeli haline geldi. RAG, AI agent, fine-tuning, vector search.

Production seviyesinde AI uygulamalari: rate limit yonetimi, fallback strategy, cost optimization, prompt engineering, evaluation — hepsi standart paketin parçası.

AI uygulama tesliminde standart

- Claude / GPT / Gemini API entegrasyonu

- RAG (vector database + retrieval)

- AI agent (multi-step, tool use)

- Prompt engineering + evaluation

- Cost monitoring + rate limit management

AI uygulamasinin temel desenleri

Modern AI uygulamasi 4 ana desen uzerinde calisir: 1) Tek-shot LLM cagrisi (genel chatbot, content generation), 2) RAG (kullanici verisini LLM'e iliskilendirme — knowledge base, dokuman QA), 3) Multi-step agent (tool use, multi-turn konuşma), 4) Fine-tuned model (sirket-spesifik dil, ton).

Karari urunun ihtiyacina gore aliyoruz. RAG cogu kurumsal kullanim icin yeterli; agent gerektigi durumlarda eklenir; fine-tuning son care.

Vector database ve RAG mimarisi

RAG (Retrieval-Augmented Generation), AI uygulamasinin sirket-spesifik veriyle calismasinin standart yolu. Postgres (pgvector), Pinecone, Weaviate veya Qdrant — vector database secimi proje boyutuna gore.

Embedding model secimi (OpenAI text-embedding-3, Cohere, Anthropic) ayri bir karar; embedding kalitesi RAG sonucunu doğrudan etkiler. Hibrit search (vector + keyword) standart yaklasimimiz.

Maliyet ve rate limit yonetimi

AI uygulamasi production'a ciktiginda dikkat edilmesi gereken iki sey: maliyet ve rate limit. Cogu LLM api'si pahali; cost monitoring ilk gunden zorunlu. Anthropic / OpenAI dashboard'larini takip eden alarm sistemini kuruyoruz.

Rate limit yonetimi icin: queueing, exponential backoff, fallback model (GPT-4 yerine GPT-3.5), prompt caching (Anthropic'in offer ettigi cache), batch API. Bunlar maliyeti %50-80 azaltabilir.

Evaluation ve prompt engineering

AI uygulamasinin kalitesi prompt engineering ve evaluation sürecinden gelir. Iyi promptlar yazmak — context, examples, structured output — kalitenin yarisi. Ikinci yarisi evaluation: hangi prompt versiyonu daha iyi cevap verdi?

Bu icin a/b test framework'leri ve eval suite'leri kuruyor; surec icinde insan eli ile annotation yaptırıyoruz. Boylece prompt'lari iteratif olarak iyileştiriyoruz.

Sikca sorulan sorular

Hangi LLM modelini kullaniyorsunuz?

Anthropic Claude (genelde tercih), OpenAI GPT, Google Gemini, Mistral. Karari kullanim case'ine ve maliyete gore aliyoruz.

Sirket verim guvende mi?

Evet. Anthropic / OpenAI Enterprise plan'larinda data privacy gemli (training'e dahil edilmez). On-premise deployment isteniyorsa Llama / Mistral gibi acik modelleri lokal calistirabiliyoruz.

AI uygulamasi maliyeti nasil hesaplanir?

Iki kismi var: gelistirme maliyeti (sabit kapsam) ve runtime LLM API maliyeti (kullanim baz�nda). Runtime maliyetini kesif sirasinda kullanim hacmine gore tahmin ediyoruz.

Fine-tuning gerekli mi?

Cogu durumda hayir. RAG + iyi prompt engineering yeterli. Fine-tuning ozel ton, format veya domain dili gerektigi durumlarda son care.

Hangi sektorlerde AI uyguladiniz?

Customer support otomasyonu, content generation, document QA, kod analizi, satis surec automation, uretim metrik yorumlama. Sektor agnostik calisabiliyoruz.

Lokasyon

AI uygulama projeleri yurutugumuz sehirler

Turkiye genelinde yapay zeka uygulamasi gelistirme talebi aliyoruz. Asagida yogun calistigimiz iller listelendi.

Secili projeler

FitTrack Mobil Uygulama

Kişisel fitness takibi ve antrenman planlama uygulaması. iOS ve Android platformlarında 50.000+ aktif kullanıcı.

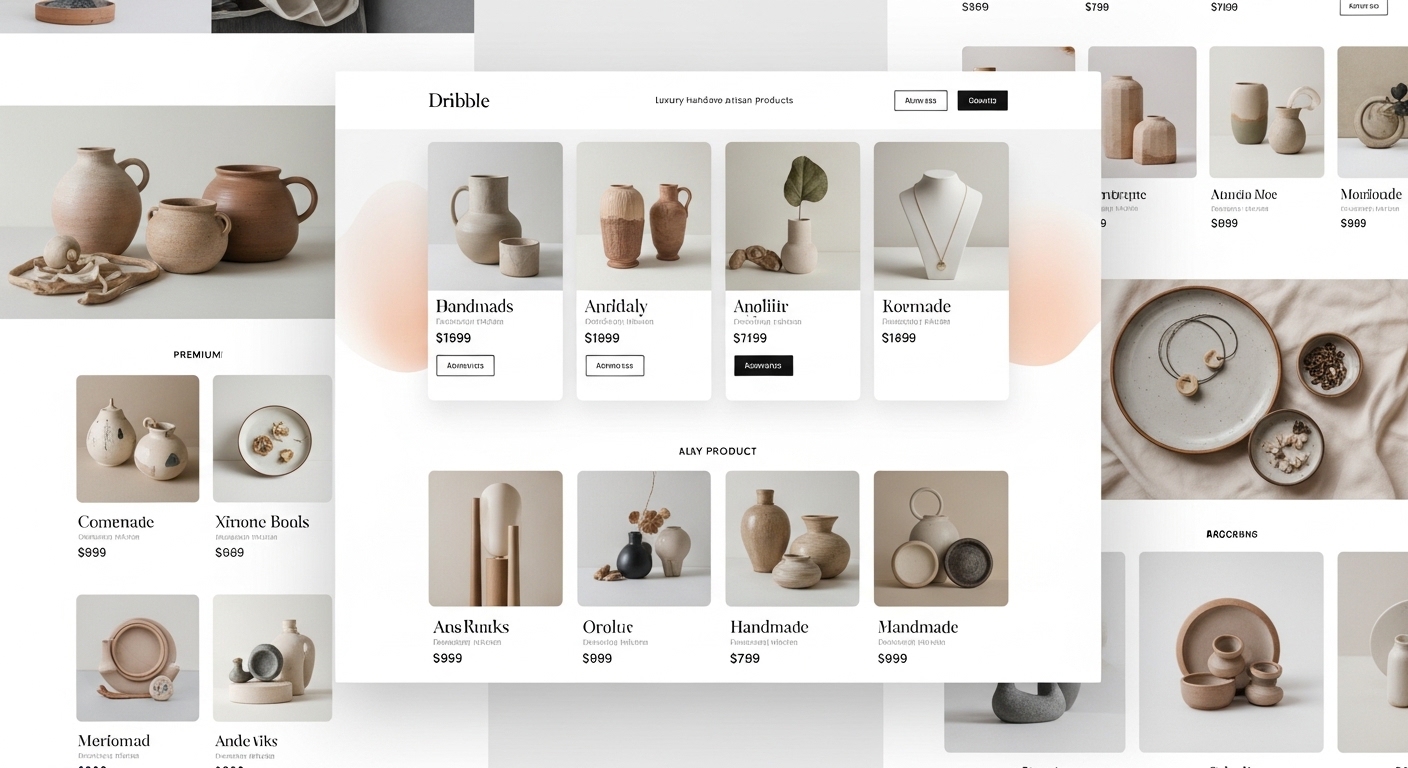

ShopZone E-Ticaret Platformu

Çok satıcılı e-ticaret platformu. Entegre ödeme sistemi, stok yönetimi ve analitik paneli.

Nova Kurumsal Web Sitesi

Enerji sektöründe faaliyet gösteren Nova şirketi için modern kurumsal web sitesi.

Ilgili rehberler

AI karari oncesi okunabilecek yazilar

AI uygulama ve LLM rehberlerimiz.

Yazilim Gelistirme

Yazilim Gelistirme Yontemleri 2026: Modern Stack ve Surec

Modern yazilim gelistirme yontemleri — TypeScript, test-first, CI/CD, modular monolit, RSC. 2026'da ne kullanmaliyiz?

7 dk

Kurumsal

ERP Yazilim Secim Kriterleri: Hazir mi Ozel mi?

ERP secimi yapan kurumsal alicilar icin hazir ERP (SAP, Logo, Mikro) vs ozel ERP karari rehberi.

6 dk

Yapay Zeka

AI Chatbot ile Musteri Destek Otomasyonu

LLM tabanli AI chatbot'un musteri destek surecini nasil donusturduguni case study formatinda inceliyoruz.

6 dk

AI uygulama projesi baslat

30 dakikalik kesif gorusmesi sonunda AI uygulama yol haritasini yazili olarak paylasiyoruz.